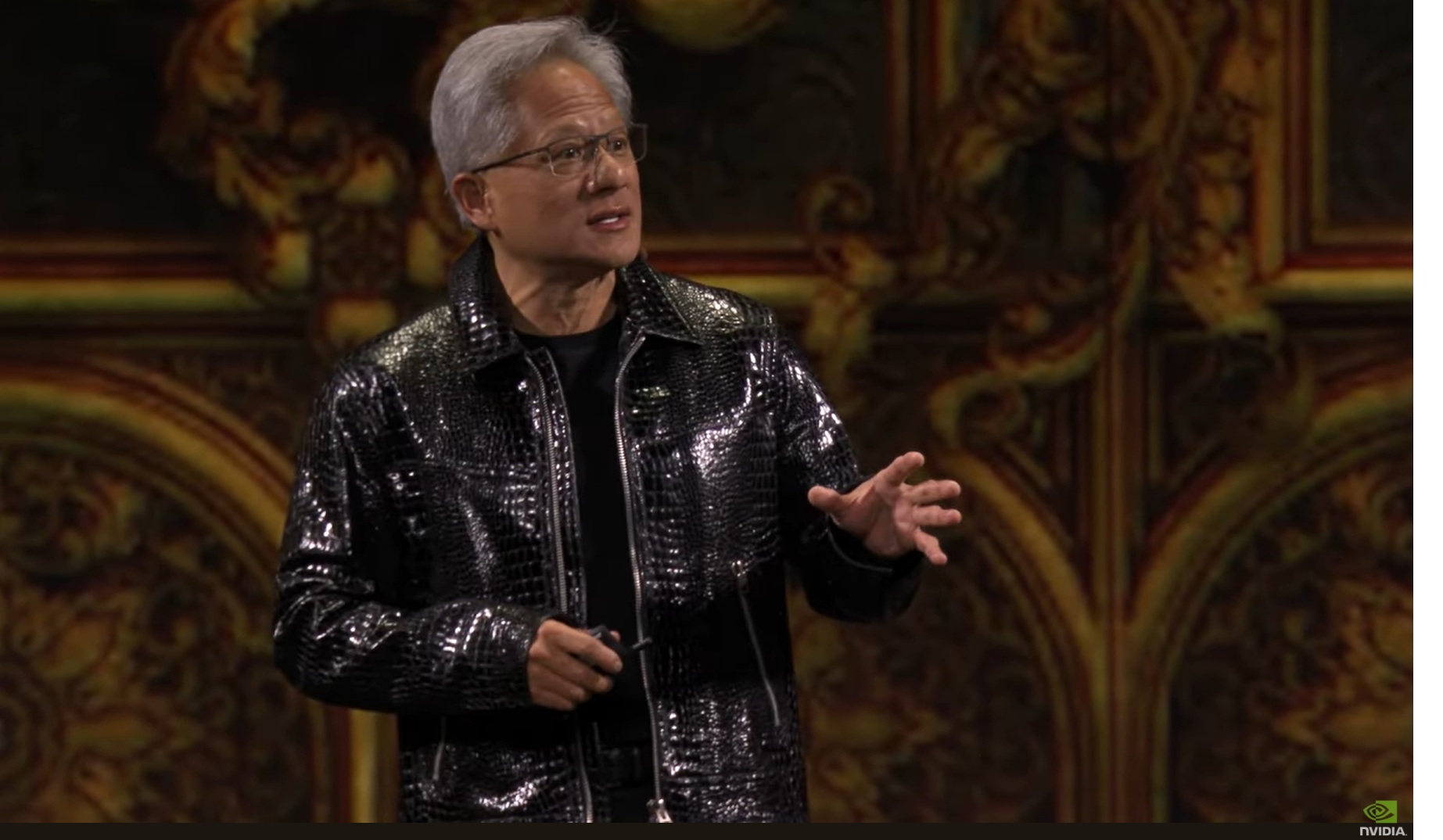

CES 2025でNVIDIAのCEO、Jensen Huang氏が行った基調講演は、“AI元年”と呼ばれる今の時代を象徴するように、そのほとんどが人工知能をめぐる新技術にフォーカスしたものとなりました。この記事では、同氏が解説した最新のAI技術や、質疑応答の中で見えてきたNVIDIAの戦略をまとめます。

CES 2025現地レポート

25年前に「Windowsアクセラレータ」と呼ばれていた3Dグラフィックス分野からスタートしたNVIDIAは、今では世界屈指の企業価値を誇り、PC向けグラフィックスからハイパースケール・データセンター、そしてロボティクスまで、あらゆる領域でAIを加速するプラットフォームを築いています。

Jensen Huang氏のQ&Aで印象的だったのは、CESのような“コンシューマー向け”イベントでありながら、SIGGRAPH(グラフィックス技術者向けカンファレンス)のように高度な技術解説が次々と飛び出す点でした。それこそがNVIDIAの立ち位置を象徴していると言えるでしょう。

「GeForce RTX 50シリーズ」とAIプラットフォームの大攻勢

RTX 50シリーズ発表、しかし注目は“AI”へ

まず、ゲーマーの注目を集めたのはNVIDIA GeForce RTX 50シリーズです。グラフィックス性能を大幅に引き上げると同時に、NVIDIAが従来から取り組んできた“DLSS”をはじめとするAI技術の進化が大きな目玉となりました。

とくに新バージョンの「DLSS 4」では、従来のフレーム生成をさらに高度化し、わずかにレンダリングしたピクセル情報をAIが補完することで、レンダリング負荷を極端に増やさずにリフレッシュレートを大幅に向上させられるといいます。

Jensen Huang氏は、「33ミリオンピクセル中、2ミリオンだけを厳密にレンダリングし、残りの31ミリオンを推論で生成する」という“未来予測”型の仕組みを強調しました。

GeForceの歴史25周年

NVIDIAが1999年にGeForceとしてグラフィックス専用チップを発表してから四半世紀。かつて80社以上あった3Dグラフィックスメーカーの中で生き残った数少ない企業としてNVIDIAは成長を続け、今やクラウドを中心とするAI市場で確固たる地位を築いています。

かつて「Windowsアクセラレータ」だった3Dチップは、ディープラーニング演算を担う“GPUコンピューティング”へと見事な転身を遂げました。

AIの物理世界理解―NVIDIAが目指す“Cosmos”

今回の基調講演で特に目を引いたのが「Cosmos」と呼ばれる新しいAI基盤です。Jensen Huang氏は「これまでのGPTが言語を理解し、Stable Diffusionが画像を理解したように、Cosmosは物理世界を理解する“ファウンデーションモデル”だ」と言います。

重力や慣性、摩擦といった物理現象、空間やオブジェクトの概念など、ヒトの子どもが当たり前に知っている“物理法則”をあらかじめ学習させたモデルを作り、それをロボットや自動車などさまざまなエッジ側AIに“教師モデル”として転移していく構想です。

なぜCosmosが必要か

これまでの生成系AIは、テキストや画像といったデジタルデータを対象に高度化してきました。しかし、ロボットや自動運転など、いわゆる「物理世界で動くAI」には、現実の物理ルールの理解が不可欠です。

そこで、大型の物理モデル(Cosmos)をクラウド上に構築し、そこからそれぞれの用途に合わせて軽量化したサブモデルを各ロボットや自動車へ配布・学習させる――そんな仕組みをNVIDIAは実現しようとしています。

Omniverseとの組み合わせ

さらに、NVIDIAのメタバース・エンジン「Omniverse」と組み合わせ、シミュレーション空間を“物理に忠実”に再現。Cosmosが理解した世界観でロボットなどを訓練し、そこで生成されたデータやフィードバックを元に再学習を行う――こうしたループを加速し、新たなロボット工学や自動車AIの発展を狙っています。

「AI PC」は定着するか―Windows+Linux=WSL2の可能性

Jensen Huang氏が基調講演や記者Q&Aで繰り返し強調したのが、“AI PC”の重要性です。クラウド側で大規模言語モデルを訓練・推論する流れが強まる一方で、まだまだローカルPC向けのAIソフトウェアは少ないと言います。

しかし実は、Windowsには「WSL2(Windows Subsystem for Linux)」があり、DockerコンテナやCUDAなどをフルにサポートできる“クラウドネイティブ”な仮想環境が存在します。

NVIDIAは、GPUをフル活用できるWSL2環境を整備し、クラウドで鍛えたAIソフトをそのままローカルへ移植できるようにしているとのこと。「AIがクラウドから“降りてくる”未来」を、PCメーカー各社と連携して推し進めていくという展望です。

ブラックウェル世代と今後のGPU進化

Jensen Huang氏は次世代アーキテクチャ「Blackwell」についても言及し、推論性能をHopper(現行H100/H200世代)比で30~40倍も高める見込みだと強調しました。

「“Mooreの法則”というトランジスタ集積の進化が鈍化しても、ソフトウェア最適化やシステム統合によってGPUの実効性能は毎年2倍ペースで伸ばせる」と断言。

GPU・NVLink・ネットワーク・電力効率など、ハードからソフトまで一体で設計し、統合的に性能を突き詰めることで、指数関数的なAIの進化を後押ししていく姿勢を示しています。

大規模推論の課題に対するアプローチ

大きなLLM(Large Language Model)や推論実行が高額になる問題に関しては、「計算性能をあげれば推論コストは下がる」という理論を繰り返し述べました。

さらに、推論で得たデータが再度学習にフィードバックされるプロセス(強化学習や合成データ生成)が進むことで、モデル自体の賢さも高まり、結果的に推論コストを下げることにつながると指摘しています。

自動車からロボットまで「すべてが自律化する」未来

2017年のCESで披露した自動運転コンセプトカーから8年――今回のQ&Aでは「今後20年でほぼすべてのクルマが自律走行機能を持つようになる」という見解をJensen Huang氏は示しました。

すでに中国のBYDやLi Auto、XPeng、NIOなどは高度なEVと自律走行で世界をリードし始めており、伝統的な自動車メーカーも追随せざるを得ない状況にあるといいます。

また、車以外にも芝刈り機や配送ロボット、工場用アームなど、物理的に動くあらゆる機器が「自律化」する未来を想定しており、そこにもCosmosやOmniverseを活用していく構想です。

まとめ:AIが新たな「コンピュータ」になる

Q&Aの最後、Jensen Huang氏は「私の世代はコンピュータを使いこなすことで科学技術を進めたが、これからの世代は“AIを使いこなす”ことで未来を切り拓く」と語りました。

「AIがすべてを変える」というJensen Huang氏の熱量は、今年のCESでも改めて明確に示されたと言えるでしょう。世の中の“当たり前”がまた大きく塗り替えられる瞬間が、すぐそこまで来ています。

参考)In the future, we will all manage our own AI agents | Jensen Huang Q&A