AIがコードもUIも即生成!Google Stitchで始まる“Vibe Coding”革命

最近目にすることが増えた“Vibe Coding”という新しいワード。従来型のコーディングやノーコードツールとは何が違うのか、業界の最新潮流はどこに向かっているのか気になっている方も多いでしょう。

この記事では、Googleが新たにリリースしたUI生成AI「Stitch」を中心に、Vibe Codingの本質や競合各社の動き、そして実際の開発現場にどんなインパクトを与えるのかを詳しく解説します。

この記事の内容は上記のGPTマスター放送室でわかりやすく音声で解説しています。

Vibe Codingとは何か?新時代の開発スタイル

Vibe Codingは、2024年にOpenAI共同創業者のアンドレイ・カーパシーによって提唱された新しい開発スタイルです。従来のAIコーディング支援は、GitHub Copilotのような「部分的なコード補完」や、「ノーコード」「ローコード」のドラッグ&ドロップツールが主流でした。

Vibe Codingは、これらの発展形であり、開発者が「どんなアプリを作りたいか」「どんなUIにしたいか」といった“雰囲気(vibes)”や要望を自然言語で伝えると、AIが即座に必要なコードやUI、場合によってはアプリ全体を一挙に生成してくれる仕組みです。

このアプローチの最大の特徴は、「プロセスよりも成果物」に重点を置いている点です。つまり、詳細な手順やコードを書くことに煩わされず、最終的なアウトプットに集中できるのです。

カーパシー氏自身も「コードの存在を忘れ、雰囲気に身を委ねて指数関数的な生産性を享受すべき」と発言しています。結果として、開発者は面倒な実装作業から解放され、よりクリエイティブな部分や上流設計に集中できる――これがVibe Codingの真髄です。

大手IT企業が続々参入するVibe Coding市場

このVibe Codingの流れに、業界大手も続々と参入しています。Googleだけでなく、Amazon Web Services(AWS)はAmazon Q Developer AIアシスタントを投入し、MicrosoftはGitHub Copilotのエージェントモードを強化。OpenAIもCodexのアップデートや、話題となったWindsurf(旧Codeium)の30億ドルでの買収が噂されています。

また、Salesforceの20%のコードはAgentforceが自動生成しているとされ、AIエージェントがプログラミングの現場で実際に活用されるフェーズに突入しています。

さらに、Windsurf(旧Codeium)、Cursor、Replit、Lovable、Bolt、Devin、Aiderといった新興プレイヤーも続々と台頭。AnthropicはコマンドラインAIエージェント「Claude Code」をリリースするなど、競争は激化しています。こうした動きは、AIによる開発自動化が“一部のタスク補助”から“エンドツーエンド自動化”へと本格移行しつつあることを意味します。

Google Stitchとは?特徴と使い方を徹底解説

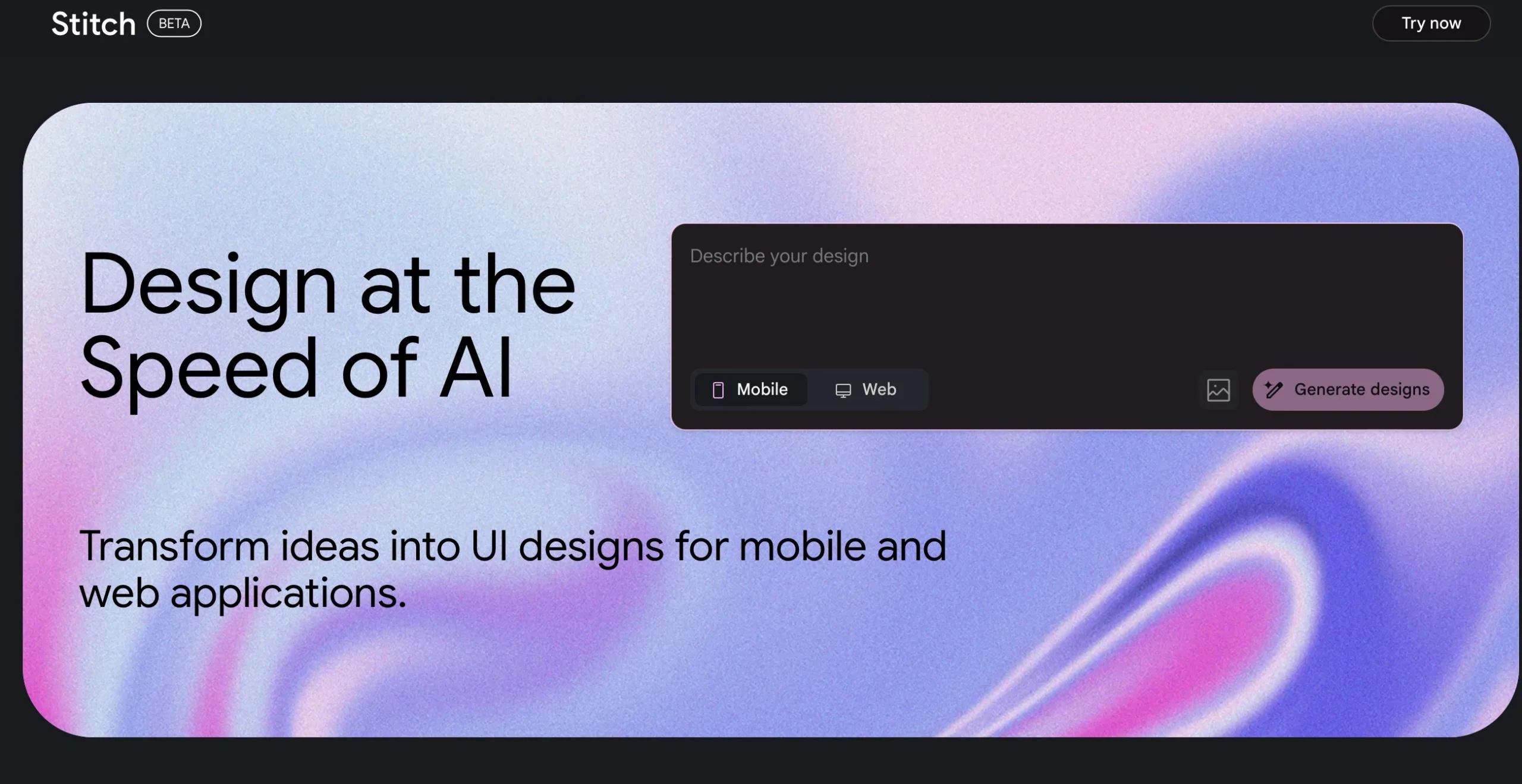

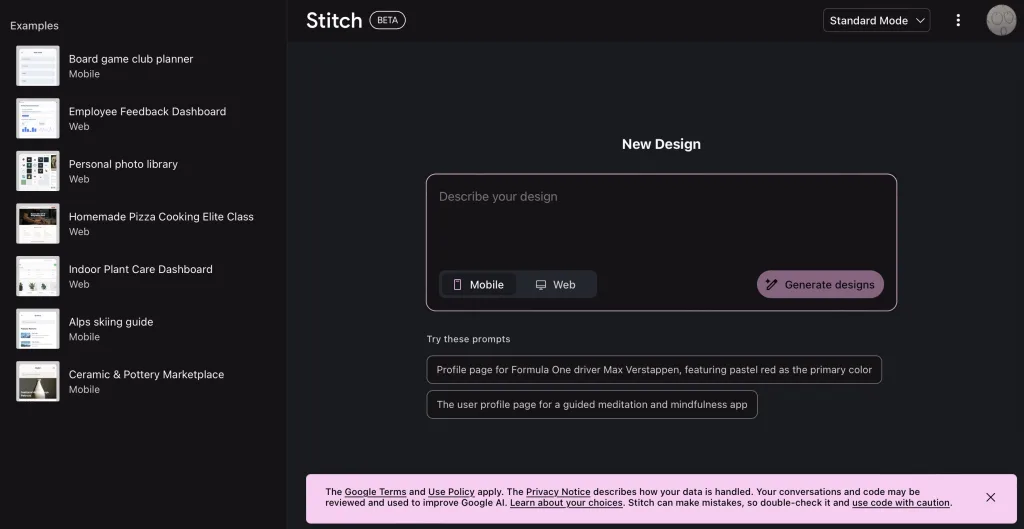

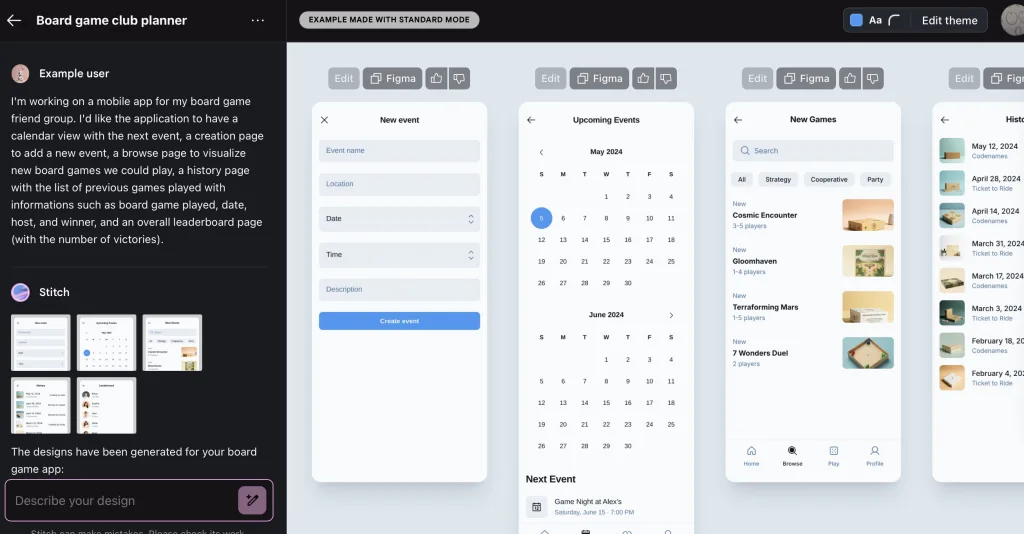

こうした流れの中でGoogleが発表したのが、UI生成AI「Stitch」です。2024年6月時点でβテストが公開されており、Google Labsの実験的プロダクトとして位置づけられています。Stitch最大の特徴は、たった一行のプロンプト(指示文)で、ダッシュボードやWebアプリ、モバイルアプリのユーザーインターフェース(UI)が一瞬で生成されることです。

たとえば「カラーは緑系で、シンプルな家計簿アプリのダッシュボード」と入力すれば、AIがHTML・CSSや各種テンプレート、編集可能なコンポーネントを自動生成。開発初心者でも、直感的にプロダクトの初期バージョン(MVP)やワイヤーフレームを作成できるのです。

Stitchの2つのモード

Stitchには2つのモードがあり、標準モードはGemini 2.5 Flashを利用、実験モードではより高性能なGemini Proが使われます。後者ではワイヤーフレームやスクリーンショットなどの画像もアップロード可能で、デザインの雰囲気や要望をより具体的に反映できます。両者の違いを表にまとめたのでご覧ください。

Stitch モード比較表(標準モード vs 実験モード)

| 比較項目 | 標準モード(Flash) | 実験モード(Pro) |

|---|---|---|

| 使用モデル | Gemini 2.5 Flash | Gemini 1.5 Pro または Gemini Pro 2.5(高性能) |

| 処理スピード | 高速(軽量・即応) | やや低速(複雑な指示処理に優れる) |

| 入力形式 | テキスト入力中心 | テキスト + 画像(ワイヤーフレーム・スクリーンショット) |

| 画像アップロード | ❌ 非対応 | ✅ 対応(UI画像・構成図などを活用可能) |

| UI生成の精度 | 一般的なUI構成に対応 | 高精度・複雑なレイアウトや雰囲気指定も可能 |

| 編集・カスタマイズ | ✅ 可能(Web上での直接編集対応) | ✅ 可能(同様にリアルタイム編集) |

| Figma連携 | ✅ エクスポート可能 | ✅ エクスポート可能 |

| アプリ組み込み | ✅ コード出力による組み込み可能 | ✅ 同上(高度な調整も反映しやすい) |

| 注釈付き画像の解析(予定) | ❌ 非対応 | ✅ 開発中:注釈付きスクリーンショットの指示をUIに反映予定 |

| 提供対象 | 一般ユーザー(無料) | 開発者・デザイナー(限定提供またはGoogle Workspace経由) |

| 料金 | 無料 | 現時点では無料(将来的に有料化の可能性あり) |

備考

- Gemini 2.5 Flash:軽量かつ高速な推論が特徴で、基本的なUIプロトタイプ生成に適しています。

- Gemini Proモード:画像+テキスト入力による「構造と意図を読み取った」高度なUI生成が可能。UI/UXデザイナーやプロダクトマネージャー向け。

- 今後の機能強化として、スクリーンショットへの注釈読み取りと反映、コンポーネント自動識別などが予定されています。

Stitchの課題

Stitch β版には改善の余地も指摘されています。デザイナーコミュニティからは「プロンプトの意図が十分に反映されず、色使いやインタラクション設計で物足りなさを感じる」「生成されたUIが静的で、細部の調整が難しい」といったフィードバックも見られます。

また、競合ツールであるBoltやCursorと比較して、レイアウトの自由度やカスタマイズ性では一歩譲るとする意見も。現時点では「MVPやワイヤーフレーム、初期ドラフト作成には最適だが、本格的なプロダクト開発にはさらなる進化が必要」との評価が妥当と言えるでしょう。

それでも、Stitchの「プロンプト一発でUIを自動生成」という体験は、多くの開発者にとって大きなインパクトを与えています。今後のバージョンアップや機能拡張によって、どこまで他ツールとの差を詰められるかが注目されます。

開発現場はどう変わる?Vibe Codingのインパクト

Vibe CodingやStitchの登場によって、ソフトウェア開発の現場は大きく変貌しつつあります。まず、フロントエンド開発の初期工程――ワイヤーフレーム作成やUIデザインのたたき台を作るフェーズが、圧倒的なスピードと少ない工数で済むようになります。

開発者やデザイナーは、従来のように細かなコーディングやツール間のデータ変換に煩わされることなく、より本質的なユーザー体験や機能設計に集中できるようになります。

また、開発未経験者やノンデザイナーでも、プロンプトを工夫するだけで高品質なUIの初稿が得られるため、プロトタイピングやアイデアの検証コストが大きく削減されます。企業にとっては、MVP(Minimum Viable Product)の開発スピードが格段に向上し、イノベーションのサイクルを加速できるというメリットが生まれます。

しかし、Vibe Codingが完成形ではないことも事実です。最終的な品質担保や細部の作り込みには、やはり人間のクリエイティビティや専門性が不可欠です。「AIが自動生成したUIをたたき台に、そこから人間が磨き上げる」という協働スタイルが、しばらく主流となるでしょう。AIの進化に合わせて、開発者やデザイナーの役割も「実装者」から「ディレクター」「クリエイティブリーダー」へとシフトしていくはずです。

Google Stitch:まとめ

AIによるVibe Codingは、従来の開発プロセスを根本から変えつつあります。Google Stitchのような新世代のUI生成AIは、開発の初期工程を劇的に効率化し、誰もが素早くプロダクトを形にできる時代を切り拓いています。

今後は人間とAIの役割分担がより明確になり、技術とクリエイティビティの最適なハイブリッドが求められるでしょう。開発者・デザイナーがAIを「敵」ではなく「強力なパートナー」として活用する――そんな時代が、すでに始まっています。