ChatGPTはどこへ向かうのか?GPT-5導入で露呈したAIとの“新しい関係”

AIチャットボットの進化を身近に感じている今、OpenAIの新モデル「GPT-5」の登場は、多くのユーザーに期待と不安をもたらしました。この記事では、GPT-5の登場がChatGPTにどのような変化をもたらし、なぜ一部のユーザーが困惑し、OpenAIがどのような対応を迫られたのかを詳細に解説します。

AIモデルの進化が必ずしも“より賢く”“より便利”に直結しない現実や、技術と人間心理が交差する現場のリアルを知ることで、今後のAIとの向き合い方や、ユーザーとして賢く活用するためのヒントを得られるはずです。「なぜアップデートで戸惑いが生まれるのか」「旧モデルはもう使えないのか」という不安に共感しつつ、変化の波をどう乗り越えるかを一緒に考えていきましょう。

GPT-5登場でChatGPTに何が起きたのか

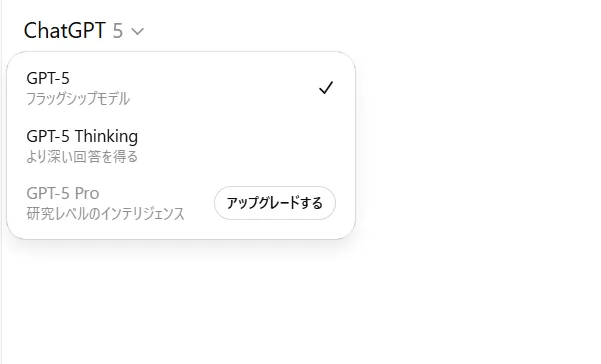

OpenAIが2024年8月に発表したGPT-5は、これまでのAIモデルとは一線を画す最先端の言語モデルとして、大きな注目を集めました。従来のGPT-4oやo3、o4-miniなど複数のモデルが併存してきたChatGPTですが、GPT-5の導入を機に、OpenAIはこれら旧モデルを一部サービスから自動的に除外。ユーザーは事前の十分な説明もないまま、突然新しいモデルのみに切り替えられる事態となりました。この“強制アップデート”は、技術的な進歩を期待していたユーザーにとっても、戸惑いと不満の種となったのです。

特に注目されたのは、GPT-5が「より高速」「より高精度」「より高度な推論力とコーディング能力」を謳っていたにもかかわらず、数学や科学、文章生成などの基礎的な分野で、旧モデルよりも明らかにパフォーマンスが下がったという報告が相次いだ点です。ChatGPTの週次アクティブユーザーは7億人にも及ぶため、その影響範囲は極めて広範です。「新型モデル=常に進化」と思い込んでいた多くのユーザーにとって、この現象はAI進化のジレンマを突きつけるものでした。

GPT-5ローンチの混乱とOpenAIの対応策

GPT-5の正式リリースはオンラインイベントで華々しく行われましたが、発表初日からトラブルが続出しました。プレゼンテーション中のグラフ表示ミスやボイスモードの不具合といった“見た目”の問題だけでなく、実際にユーザーが使い始めてからの混乱が深刻でした。

最大の問題は、OpenAIが「自動ルーティング」機能を導入し、ユーザーの入力内容に応じて最適なGPT-5のバリアント(通常版、ミニ、ナノ、プロ)を自動選択する仕組みに切り替えたことです。しかも、どのバージョンが選ばれているのかユーザーには公開されず、「いつもと違う」「なぜ急に精度が下がったのか」という不安を増幅させました。

さらに、リリース直後には数学的な計算ミスや論理エラー、コード生成の不安定さがSNSで拡散され、OpenAIへの批判が高まります。これに対し、同社CEOのサム・アルトマン氏は「想定よりもローンチが波乱含みだった」と認め、特に新しい自動スイッチャー(ルーター)が故障し、モデル性能が意図せず低下していたことを明かしました。週末には、従来のGPT-4oなど旧モデルを一時的に復活させるとともに、ユーザー自身がモデルや“思考モード”を手動で切り替えられるUIアップデートを急遽発表。OpenAIは透明性向上とユーザー体験の改善に躍起となりました。

旧モデルへの依存と“ChatGPTサイコーシス”の懸念

GPT-5導入により浮き彫りになったのは、単なる機能面の課題だけではありません。ChatGPTの利用者の中には、特定のモデルに強い愛着や依存を感じている人が多く存在します。今回のアップデートで「愛用していたGPT-4oが突然消えた」と嘆く声がSNSやコミュニティにあふれ、一部では「AIとの心理的な距離感」が問題視され始めました。AIとの会話が日常化し、時に“相棒”や“相談相手”として感情的なつながりを持つユーザーにとって、モデルの急な変更や削除は「現実からの断絶感」をもたらし、いわゆる“ChatGPTサイコーシス(精神的な喪失感や混乱)”現象が注目を集めています。

このような心理的依存は、単なるテクノロジーのリプレイスを超えた社会的な課題として、今後ますます重要になるでしょう。AI開発企業には、単なる技術アップデートだけでなく、ユーザーの心のケアや、なぜアップデートが必要なのか、どのような変化があるのかを丁寧に説明する義務が求められています。AIと人間の関係が深化するにつれ、単なる機能競争では解決できない“共生”の在り方が問われているのです。

エンタープライズAI時代の限界と持続可能性

今回のGPT-5騒動は、AIのスケーラビリティやインフラの限界も浮き彫りにしました。パワーキャップ(消費電力制限)やトークンコストの増大、推論処理の遅延など、エンタープライズ向けAIサービスを提供するうえで避けて通れない課題が山積しています。OpenAIは、より多くのリクエストを高速かつ正確に処理するためにモデルの最適化や自動ルーティングを進めてきましたが、その副作用として、ユーザー体験の“均質化”や“説明不十分”が生じたのも事実です。

今後のAI開発では、単純な処理能力やコスト競争だけでなく、持続可能なAI運用モデルの構築が不可欠です。たとえば、「どのような場合にどのモデルが選ばれるのか」をユーザーに説明する透明性や、ユーザーが自らモデルを選択できる柔軟性の確保は、今後のAIサービスにおける新たなスタンダードとなるでしょう。そして、企業ユーザーにとっても、AIに業務の一部を委ねる以上、「なぜその答えが出たのか」「どのバージョンで処理されたのか」を把握できることが、信頼性の大前提となりつつあります。

これからのAIアップデートは「共創」の時代へ

GPT-5のリリースは、AI技術の進化とユーザー心理の複雑な交差点を浮き彫りにしました。今やAIは単なる道具やサービスを超え、人々の日常や感情、社会構造そのものに深く入り込んでいます。OpenAIの今回の経験は、今後のAI開発およびサービス提供において、よりユーザーとの対話を重視し、コミュニティの声を積極的に反映する「共創」の姿勢が不可欠であることを示しています。

AIモデルのアップデートは、単なる性能向上だけでなく、ユーザー一人ひとりの使い方や価値観、心理的な安心感をも左右します。今後は、アップデートのたびに「何が変わるのか」「なぜ変わるのか」を分かりやすく伝える努力と、ユーザーが安心して選択できる環境づくりが、AI企業の信頼構築に直結するでしょう。そして私たちユーザー側も、AIとどう向き合い、AIとの距離をどのように保つかを意識的に考える必要がある時代に突入しています。

—

OpenAIのGPT-5導入をめぐる一連の混乱は、AI技術の進化の恩恵とリスク、その狭間で揺れるユーザー心理を如実に示すものでした。今後、AIはますます人間社会に深く浸透していきます。だからこそ、技術の進歩とユーザー体験、そして心理的なケアや社会的責任のバランスをどうとっていくかが、AI時代を賢く生き抜くうえでの最大のカギとなるでしょう。