Mastraがもたらす画期的なAIエージェント開発の全貌

Gatsby.js開発チームが満を持して発表した「Mastra」が、AIエージェント開発の常識を変えています。GitHubスター数が短期間で7,500を突破し、開発者コミュニティを沸かせているこのTypeScriptフレームワークは、なぜこれほど注目されているのでしょうか?

本記事では、複雑だったAIアプリケーション構築をシンプルに、そして高速に実現する「Mastra」の全容と実践的な活用法を徹底解説します。

🎧この記事についてポッドキャスト風の音声解説はこちら↓

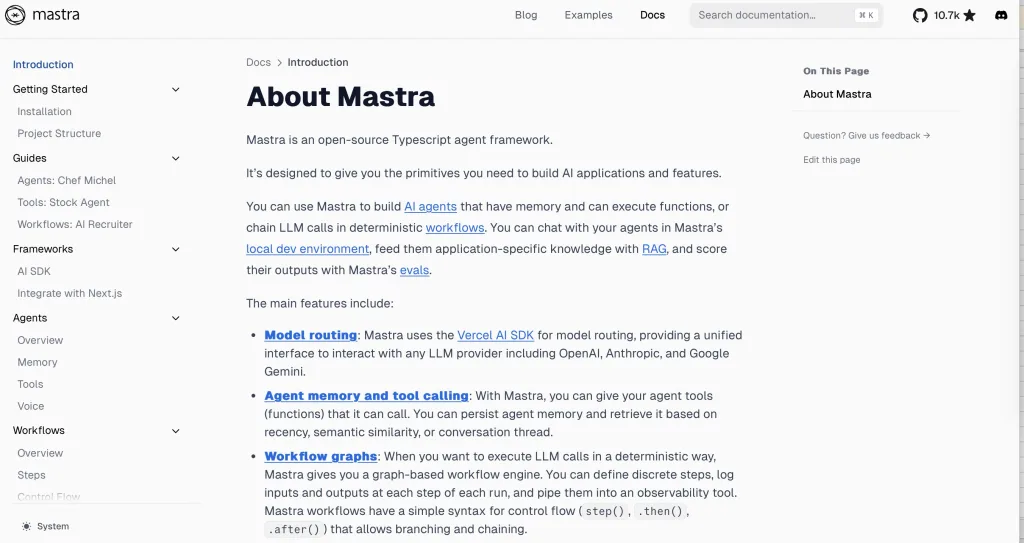

Mastraとは何か?

Mastraは、AIエージェント開発のハードルを大幅に下げるオープンソースフレームワークです。従来、AIアプリケーション構築では、LLM管理、デプロイ準備、評価指標実装といった多岐にわたる工程が開発者の負担となっていました。

このフレームワークは、それら複雑な作業に必要な「プリミティブ」(基礎構成要素)を包括的に提供し、開発プロセスを合理化します。TypeScriptベースの設計により、JavaScript/TypeScriptエコシステムに馴染んだ開発者なら、学習コストを最小限に抑えながら高度なAIアプリケーションを短期間で実装できます。

既存のnpmパッケージやWebツールとの親和性も高く、エンタープライズレベルの開発にもスムーズに対応可能です。

Gatsby.js開発チームの実績が裏付ける信頼性

Mastraは、有名なReact向けウェブサイトフレームワーク「Gatsby.js」を生み出したチームによって設立されました。Gatsby.jsで培われたオープンソース運営やスケーラビリティのノウハウがそのまま生かされているため、コミュニティによる積極的なサポートや、開発者エクスペリエンスに配慮した設計が期待できます。

実際に、GitHubスター数はリリース後に3,000から7,500へと急伸しており、早期から注目と支持を集めている点も信頼性の証といえるでしょう。

Mastraの主要機能と特徴

1. Vercel AI SDKを活用したモデルルーティング

OpenAIやAnthropic、Google Geminiなど、複数のLLMプロバイダーと連携するための統一インターフェースを提供しています。

これにより、特定のプロバイダーに縛られずに必要なモデルを切り替えたり、複数モデルを組み合わせたりできる柔軟性が得られます。新しいLLMが登場しても大幅なコード変更が不要なため、将来に向けた拡張性が高いのが利点です。

2. 記憶とツール呼び出しが可能なAIエージェント

Mastraでは、AIエージェントに「記憶」を持たせることができます。会話履歴や過去のインタラクションに基づいて状況を把握し、一貫した応答やパーソナライズを実現します。

また、外部の関数(ツール)を呼び出す仕組みも用意されているため、文章生成だけでなく、実際にタスクを実行するエージェントを構築できます。記憶検索は「最近性」「意味的類似性」「会話スレッド」など複数の戦略に対応し、用途に応じて選択可能です。

3. ワークフローグラフで複雑なタスクをオーケストレーション

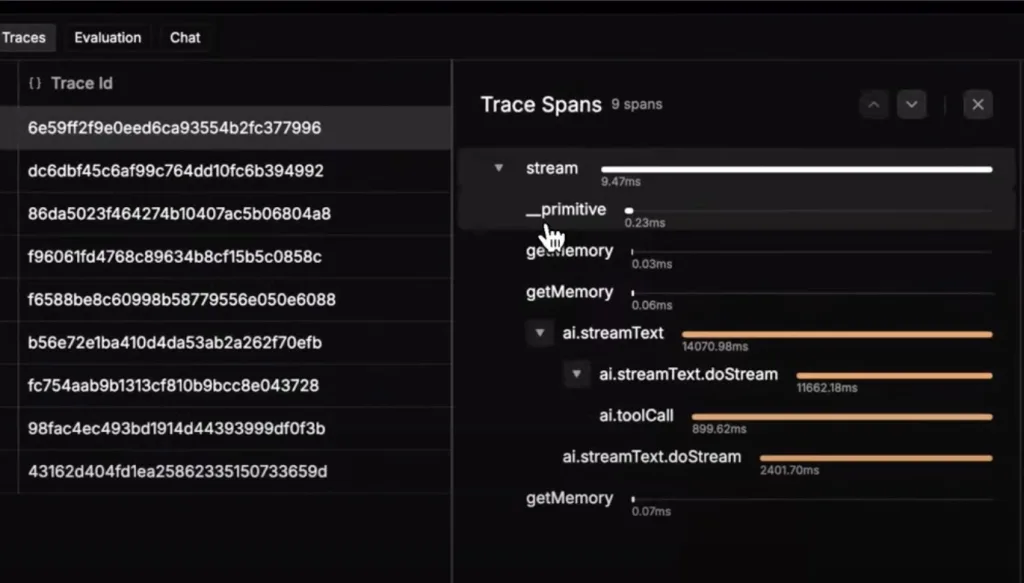

AI開発には、LLM呼び出しを含む複数のステップを連携させる高度な制御フローが求められます。Mastraはグラフベースのワークフローエンジンを備え、分岐やループ、人間による入力を挟むなど複雑なプロセスを可視化しながら定義できます。

トレーシング機能により、各ステップの入出力をログとして確認できるため、デバッグやモニタリングがしやすいのも魅力です。

さらに、ビジュアルエディタの登場により、直感的にドラッグ&ドロップでワークフローを作成できるようになる予定です。

4. 検索拡張生成(RAG)のサポート

大規模言語モデルだけではカバーしきれないドメイン固有の情報や最新の情報を活用するため、MastraはRAGをサポートしています。

外部ドキュメントを取り込み、埋め込み生成を行い、ベクターストア(Pineconeやpgvectorなど)に保存し、必要に応じて検索する仕組みが統合されています。これにより、より正確で信頼性の高い応答を得ることが可能になります。

5. 外部サービスとの安全な統合

Mastraでは、サードパーティAPIへのタイプセーフなアクセスが可能です。

自動生成されるAPIクライアントをツールやワークフローの一部として組み込めるため、外部サービスとの連携でエラーを最小限に抑えつつ、コード補完やエラー検出を活用してスムーズに開発できます。

6. 評価(Evals)機能で品質を保証

AIの応答精度や毒性、偏りなどを評価するメトリクスを標準で備えています。自動評価を行う仕組みがあることで、LLMの品質を継続的にモニタリングし、改善サイクルを回すことが容易になります。

カスタム評価基準も設定できるため、プロダクトやユースケースごとの要件に合わせた柔軟なテストが可能です。

7. 柔軟なデプロイメントオプション

Next.jsやNode.jsアプリケーションへの組み込み、スタンドアロンエンドポイントとしての運用など、目的に応じて複数のデプロイ手法を選べます。

VercelやCloudflare Workers、Netlifyなどのサーバーレス環境にも容易に対応でき、スケールアウトやインフラ管理の手間を減らしながら本番環境運用に耐えうるAIアプリケーションを実装できます。

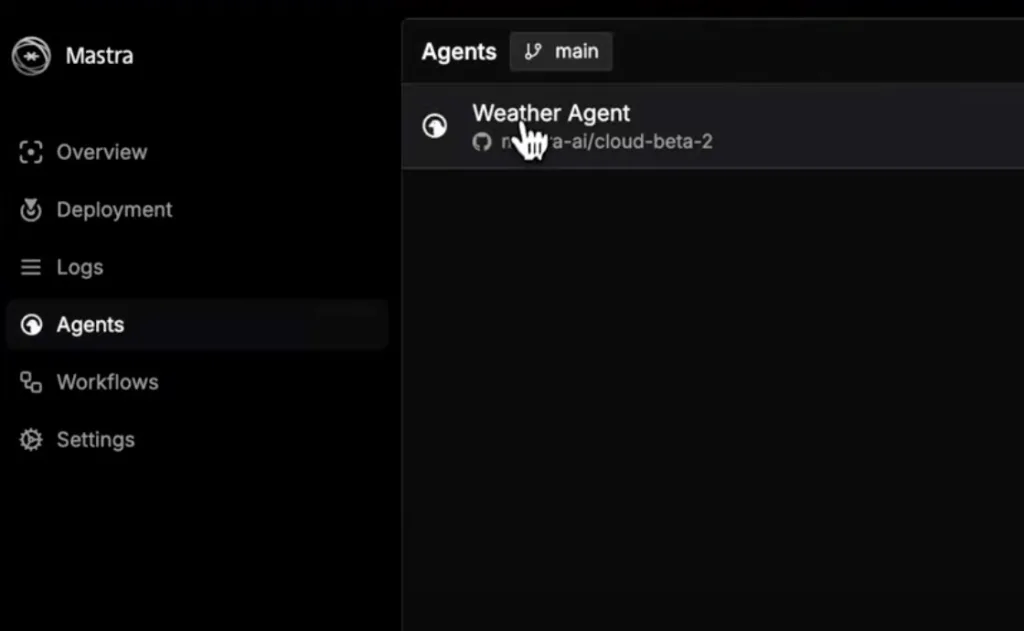

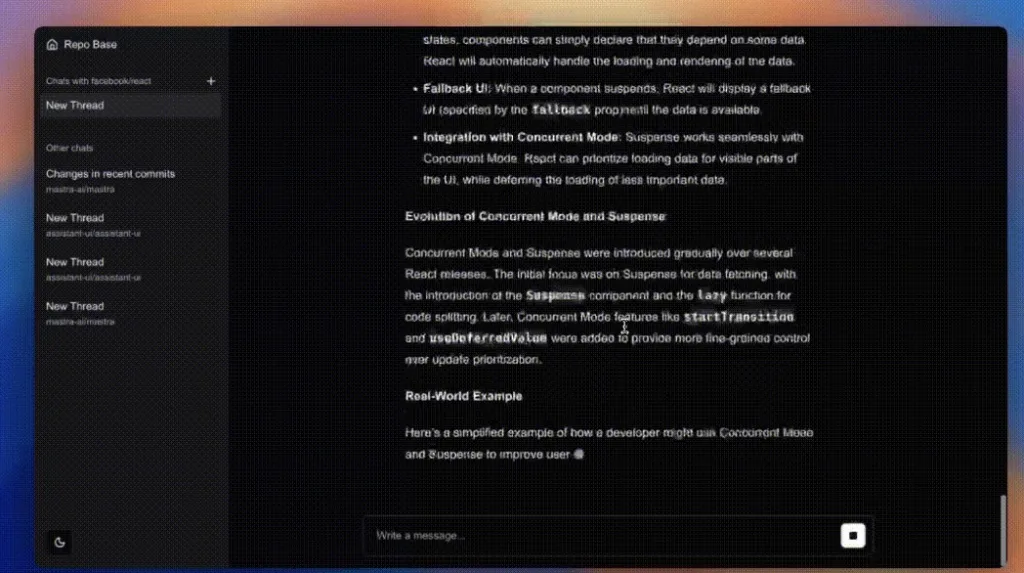

8. エージェント開発環境の充実

Mastraには、ローカル環境でエージェントと対話し、その内部状態や記憶を確認できる機能が整っています。開発中にリアルタイムで挙動を観察し、問題を素早く修正しやすい仕組みがあるのは大きなメリットです。

さらにワークフローの実行状況を視覚的に把握できるプレイグラウンドも提供されるなど、開発者体験を意識した設計が随所に見られます。

Mastraと他のツールとの比較

他の代表的なエージェント系ツールと比較してまとめましたので、ご覧ください。

| 機能 | Mastra | LangChain | AutoGen | Semantic Kernel |

|---|---|---|---|---|

| 言語 | TypeScript | Python, JavaScript | Python, .NET | C#, Python, Java |

| オープンソース | はい | はい | はい | はい |

| マルチエージェントサポート | はい | LangGraphを通じて | はい | はい |

| ワークフロー管理 | グラフベースのワークフローエンジン 、視覚的エディタ | 柔軟なワークフロー、LangGraphによる高度なオーケストレーション | 複雑なタスクのためのマルチエージェント会話 | プランナーによる自動プラグインオーケストレーション |

| RAG機能 | ドキュメント処理、埋め込み作成、ベクターDB統合 、複数のベクターストアと埋め込みプロバイダーをサポート | ベクターDB統合とメモリユーティリティ 、高度なRAGテクニック | 知識ベース構築のためのETLパイプライン | 検索と情報検索 、ベクトルストアのサポート |

| ツール呼び出し | エージェントとワークフローによるツール(関数)の実行 、タイプセーフなAPIクライアント | ツール統合 | エージェントによるツールの利用 | プラグインとしてのツールの定義と利用 |

| 評価指標 | モデルグレード、ルールベース、統計的手法 、毒性、偏り、関連性、事実の正確性などの組み込み指標 、カスタム評価の定義 | LangSmithプラットフォームによるデバッグ、テスト、パフォーマンス監視 | エージェントパフォーマンスの評価とベンチマークのためのAutoGen Bench | – |

| デプロイメントオプション | React、Next.js、Node.jsアプリケーション内、またはスタンドアロンエンドポイント 、サーバーレスプラットフォームへのデプロイヘルパー | – | ローカルまたはサーバーレスクラウド | – |

| GitHubスター数 | 7,500以上 | 103,000以上 | 19,400以上 (ag2ai/ag2は2,100以上 ) | 23,500以上 |

Mastraの実践的活用シナリオ

Mastraの機能を最大限に活用できる代表的なユースケースをご紹介します。

1. カスタマーサポート自動化

複数の商品情報やFAQをRAG機能で取り込み、ワークフローグラフを使って「質問理解→情報検索→回答生成→満足度確認」という流れを構築できます。エージェントの記憶機能により、同一顧客との会話履歴を保持し、一貫性のあるサポートを提供可能です。

2. 社内ドキュメント検索アシスタント

社内文書や技術資料をベクターDBに格納し、自然言語で質問するだけで関連情報を抽出・要約するエージェントを構築できます。Mastraのツール呼び出し機能を活用すれば、検索結果に基づいて社内システムへのチケット作成なども自動化可能です。

3. マルチステップ意思決定支援

複雑な意思決定プロセスをワークフローグラフでモデル化し、各ステップでの判断をAIが支援します。評価機能を組み込むことで、提案内容の品質や偏りを継続的にモニタリングし、信頼性の高い意思決定をサポートします。

Mastra:まとめ

Mastraは、AIエージェントの開発を効率化しつつ、プロダクト運用やスケーラビリティにも配慮した包括的なフレームワークです。TypeScriptベースで学習コストが低く、Vercel AI SDKをはじめとするさまざまな抽象化レイヤーを用いて、複数のLLMやベクターストアとの連携もスムーズに行えます。

ビジュアルエディタや強力なトレーシング機能、エージェントの記憶管理から評価機能までを網羅しているため、AI開発を一通りカバーするワンストップソリューションとして注目を集めています。もし「AI開発は難しい…」という印象をお持ちなら、まずはMastraを試してみてはいかがでしょうか。実例を重ねるほどに、その柔軟性と生産性向上の効果を実感できるはずです。