Anthropicの新モデルが示す次世代AI技術の姿

AIの進化は日々加速していますが、「AIの思考過程」を実際に見られるとしたらどうでしょうか?Anthropicの最新モデル「Claude 3.7 Sonnet」は、まさにその革新的な機能を提供します。

本記事では、「思考する」AIとして業界初のハイブリッド推論モデルの実力と可能性を詳しく解説します。このモデルがどのようにして従来のAIの限界を超え、ユーザー体験を向上させるのか、そしてビジネスや開発者にとってどのような価値をもたらすのかを理解することで、AI技術の最前線に立つことができるでしょう。

「AIに思考させる時間を自分で決められる」という発想は、多くの人が想像していなかった方向性かもしれません。なぜAnthropicはこの道を選んだのでしょうか?

業界初の「ハイブリッド推論モデル」とは

Anthropicは2025年2月24日、新しいAIモデル「Claude 3.7 Sonnet」を発表しました。このモデルの最大の特徴は、ユーザーが望む限りの時間「思考」できるように設計されていることです。Anthropicはこれを「ハイブリッドAI推論モデル」と呼んでいます。なぜなら、リアルタイムの回答と、より熟考された「思考済み」の回答の両方を提供できる単一のモデルだからです。

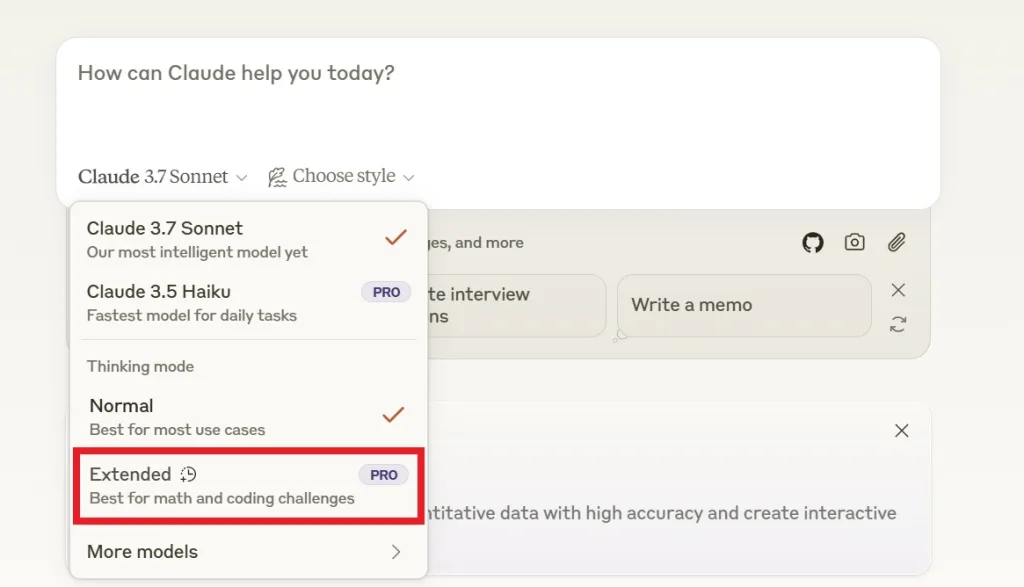

ユーザーは、Claude 3.7 Sonnetの「推論」能力を有効にするかどうかを選択でき、有効にした場合、短時間または長時間の「思考」を促すことができます。これはAnthropicのAI製品のユーザーエクスペリエンスを簡素化する広範な取り組みの一環です。

現在のほとんどのAIチャットボットには、コストと能力が異なる複数のオプションからユーザーが選択する必要があり、それが障壁となっていました。Anthropicのような研究所は、ユーザーがこうした選択について考える必要がなく、一つのモデルがすべての作業を行うことが理想と考えています。

導入とアクセス条件

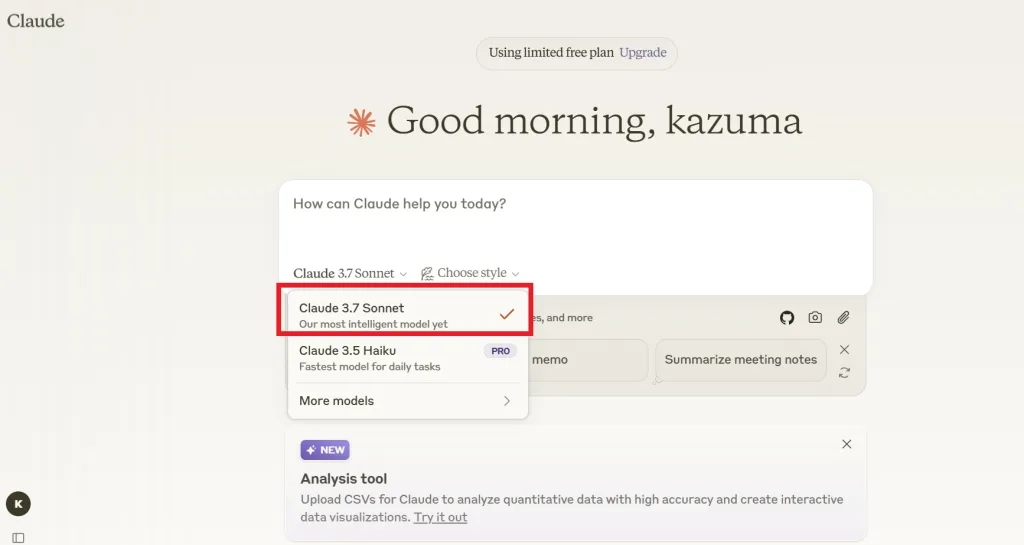

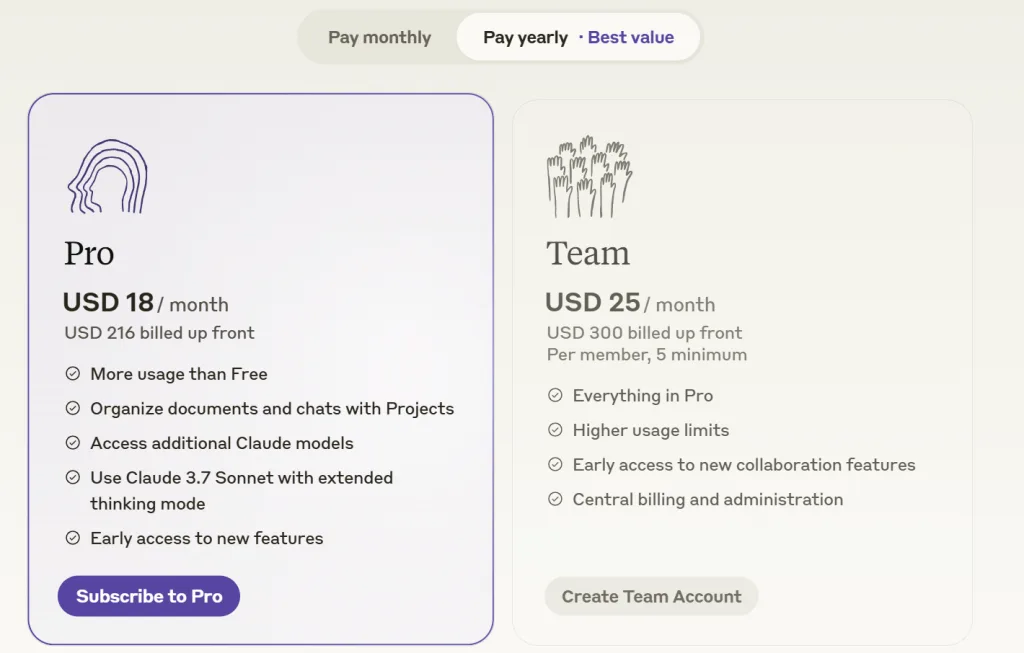

Claude 3.7 Sonnetは2025年2月24日からすべてのユーザーと開発者に提供されますが、モデルの推論機能にアクセスできるのはAnthropicのプレミアムClaudeチャットボットプランを利用する有料ユーザーのみです。

無料のClaudeユーザーは、標準的な非推論版のClaude 3.7 Sonnetを利用することになります。これは、Anthropicによれば、前回のフロンティアAIモデルであるClaude 3.5 Sonnetよりも優れたパフォーマンスを発揮するとのことです。

コスト面では、Claude 3.7 Sonnetは入力トークン100万個あたり3ドル(約75万語、「指輪物語」シリーズの全文よりも多い量の単語をClaudeに入力できる量)、出力トークン100万個あたり15ドルとなっています。

これはOpenAIのo3-mini(入力トークン100万個あたり1.10ドル/出力トークン100万個あたり4.40ドル)やDeepSeekのR1(入力トークン100万個あたり0.55ドル/出力トークン100万個あたり2.19ドル)よりも高価ですが、o3-miniとR1は純粋な推論モデルであり、Claude 3.7 Sonnetのようなハイブリッドではないことを考慮する必要があります。

「思考」の仕組みと可視化

Claude 3.7 Sonnetは、従来のAIパフォーマンス向上手法が頭打ちになる中、多くのAI研究所が着目している「推論」技術を取り入れたAnthropicの初めてのAIモデルです。

o3-mini、R1、GoogleのGemini 2.0 Flash Thinking、xAIのGrok 3(Think)のような推論モデルは、質問に答える前により多くの時間とコンピューティングパワーを使用します。これらのモデルは問題をより小さなステップに分解し、最終的な回答の精度を向上させる傾向があります。推論モデルは必ずしも人間のように思考や推論をするわけではありませんが、そのプロセスは演繹的思考をモデルにしています。

最終的にAnthropicは、ユーザーが事前にコントロールを選択する必要なく、Claudeが質問について「考える」べき時間を自分で判断できるようにしたいと考えています。Anthropicの製品・研究責任者であるDianne Pennはインタビューで次のように語っています:「人間が即答できる質問と考えが必要な質問に対して別々の脳を持っていないのと同様に、私たちは推論を単にフロンティアモデルが持つべき能力の一つと考えており、他の能力と円滑に統合されるべきものであり、別個のモデルで提供されるものではないと考えています」

特に注目すべき点は、Anthropicが「可視スクラッチパッド」を通じてClaude 3.7 Sonnetの内部計画フェーズを表示できるようにしていることです。Pennによれば、ユーザーはほとんどのプロンプトに対するClaudeの完全な思考プロセスを見ることができますが、信頼性と安全性の目的で一部が編集される場合もあるとのことです。

実世界での性能

Anthropicは、難しいコーディングの問題やエージェント的なタスクなど、実世界のタスクに合わせてClaudeの思考モードを最適化したと述べています。AnthropicのAPIを利用する開発者は、思考の「予算」をコントロールし、速度とコストを回答の品質とトレードオフすることができます。

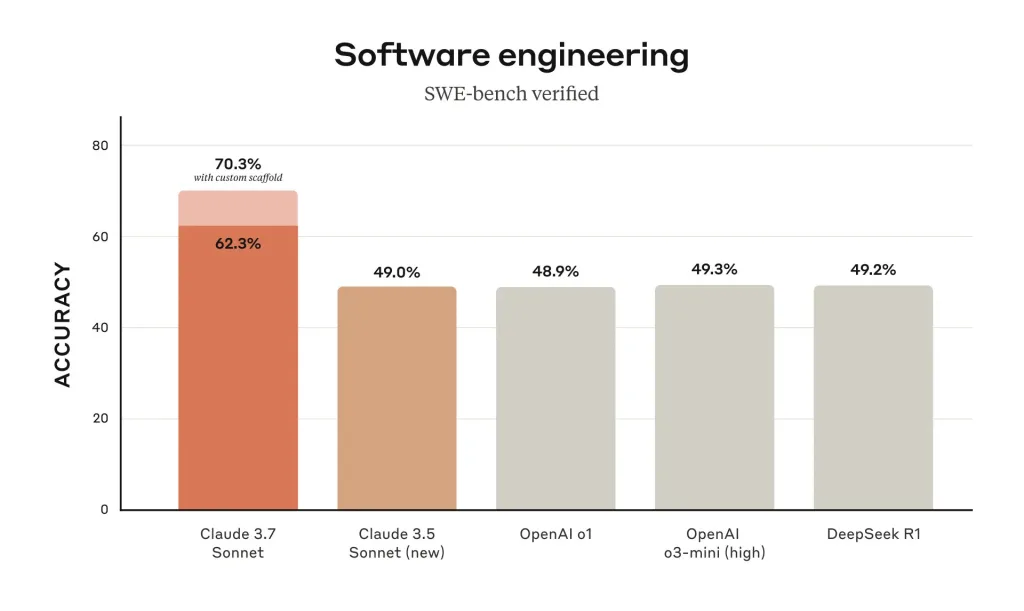

実世界のコーディングタスクを測定するテスト「SWE-Bench」では、Claude 3.7 Sonnetの精度は62.3%であり、OpenAIのo3-miniモデルの49.3%を上回りました。

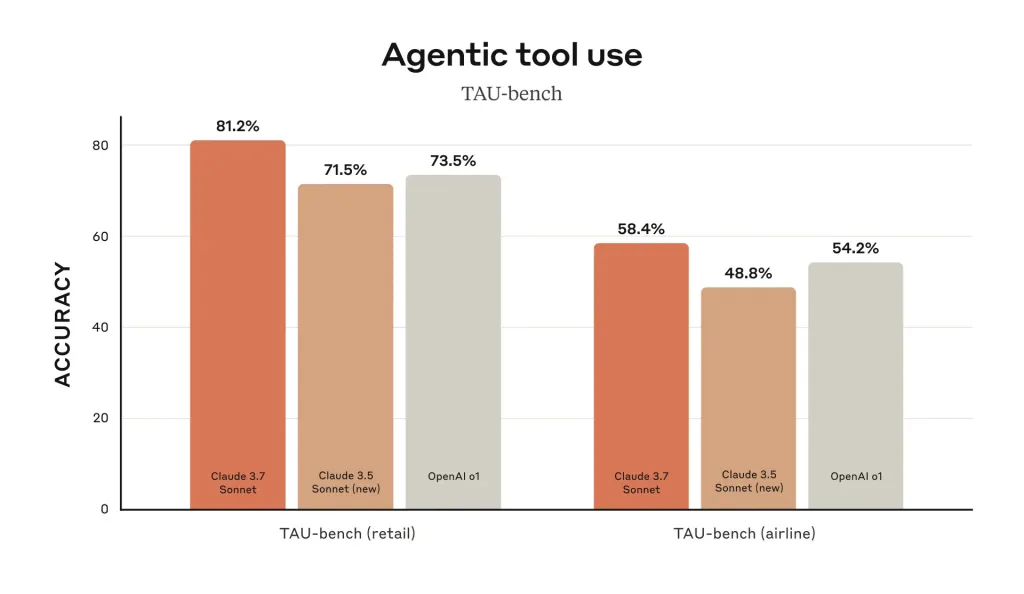

また、小売環境でのシミュレーションユーザーや外部APIとのAIモデルの相互作用能力を測定する別のテスト「TAU-Bench」では、Claude 3.7 Sonnetは81.2%のスコアを記録し、OpenAIのo1モデルの73.5%を上回りました。

さらに注目すべき点として、Anthropicはこのモデルが従来のモデルよりも質問への回答を拒否する頻度が低くなると主張しています。Claude 3.7 Sonnetは有害な問い合わせと無害な問い合わせをより細かく区別する能力を持ち、Claude 3.5 Sonnetと比較して不必要な拒否を45%削減したとのことです。これは、一部の他のAI研究所がAIチャットボットの回答制限アプローチを再考している時期に発表されたものです。

Claude Codeの導入

Claude 3.7 Sonnetに加えて、Anthropicはエージェント型コーディングツール「Claude Code」もリリースします。研究プレビューとして立ち上げられるこのツールを使用すると、開発者は端末から直接Claudeを通じて特定のタスクを実行することができます。

デモでは、Anthropicの従業員が「このプロジェクト構造を説明して」といった単純なコマンドでClaude Codeがコーディングプロジェクトを分析する方法を示しました。開発者はコマンドラインで平易な英語を使用してコードベースを修正することができます。Claude Codeは変更を加える際にその編集内容を説明し、プロジェクトのエラーをテストしたり、GitHubリポジトリにプッシュしたりすることもできます。

Claude Codeは当初、「先着順」で限られた数のユーザーに提供される予定です。

業界の動向と今後の展望

Anthropicは、AI研究所が猛烈なペースで新しいAIモデルを発表している時期にClaude 3.7 Sonnetをリリースしています。Anthropicは歴史的に、より計画的で安全性重視のアプローチを取ってきました。しかし今回は、業界をリードすることを目指しているようです。

ただし、その優位性がどれだけ続くかは疑問です。OpenAIも独自のハイブリッドAIモデルのリリースに近づいている可能性があり、同社のCEOであるSam Altmanは「数ヶ月以内」に到着すると述べています。

この競争の中で、「思考する」AIの進化が今後どのような方向に向かうのか、そして私たちの生活やビジネスにどのような影響をもたらすのかは非常に興味深い点です。特に、AIの「考える時間」を人間が制御できるという新しいパラダイムは、AI技術の新たな可能性を示唆しています。

まとめ

Anthropicの新しいAIモデル「Claude 3.7 Sonnet」は、「思考」プロセスの可視化という画期的な機能を提供し、AI技術の新たな地平を切り開いています。ユーザーがAIの思考時間を制御できるという革新的なアプローチは、より高度で信頼性の高い回答を得ることを可能にし、開発者や企業にとって大きな価値をもたらす可能性があります。

またClaude Codeのようなツールの導入は、AIとのインタラクションをより直感的かつ効率的にする方向性を示しています。AIが「考える」様子を実際に見ることができるという体験は、AIへの理解と信頼を深める重要なステップとなるでしょう。

今後もAI技術の進化は加速し続けるでしょうが、Anthropicのこの取り組みは単なる性能向上だけでなく、人間とAIの協働関係の質を高める重要な一歩と言えるでしょう。